O documentário “Coded Bias” (2020), dirigido por Shalini Kantayya, apresenta uma investigação sobre os vieses presentes em algoritmos de inteligência artificial, especialmente aqueles utilizados em sistemas de reconhecimento facial e em processos decisórios automatizados.

Em “Coded Bias”, nós acompanhamos a trajetória de Joy Buolamwini, pesquisadora do MIT Media Lab, que ao testar algoritmos que deveriam simplesmente reconhecer rostos, percebeu que estes falhavam em identificar corretamente mulheres negras.

A partir dessa constatação, Buolamwini inicia uma jornada de pesquisa e ativismo, questionando empresas de tecnologia e órgãos governamentais sobre as implicações éticas dessas falhas.

Coded Bias expõe não apenas questões técnicas, mas também os impactos sociais de um desenvolvimento tecnológico aparentemente neutro.

Quem é Joy Buolamwini, a “protagonista” de Coded Bias

Joy Buolamwini, que ganhou notoriedade com o TED Talk acima em 2017, é o centro da narrativa de Coded Bias.

Mulher, negra e especialista em tecnologia, ela identifica um problema que passa despercebido pela maioria: os sistemas de reconhecimento facial têm dificuldades de identificar rostos com peles mais escuras.

Buolamwini, faz o teste. Um mesmo sistema que não reconhece seu rosto, reconhece uma máscara branca. Uma espécie de código de programação enviesado por práticas racistas e, ao mesmo tempo, uma alusão à obra Pele Negra, Máscaras Brancas, de Frantz Fanon.

A constatação leva Buolamwini a aprofundar os estudos sobre representatividade de dados nos modelos de inteligência artificial. Ela funda a Algorithmic Justice League, um grupo voltado para a conscientização sobre viés em software e para a advocacia por sistemas mais justos.

A atuação do grupo vai além da pesquisa acadêmica, envolvendo audiências no Congresso dos Estados Unidos e debates públicos sobre a necessidade de regulação da tecnologia.

O problema dos vieses algorítmicos em Coded Bias

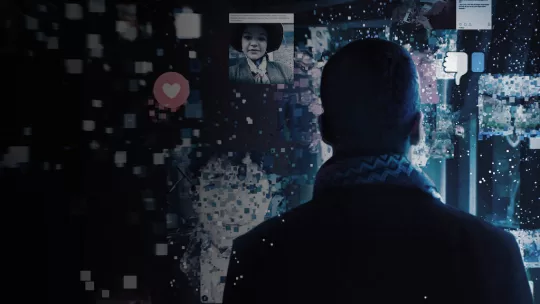

A partir desse ponto, Coded Bias desenrola-se como uma combinação entre pesquisa científica, investigação jornalística e ativismo social.

No desenvolvimento, o documentário sobressai ao apresentar a trajetória de Buolamwini e, em paralelo, trazer outros casos emblemáticos: estudantes expondo falhas em algoritmos usados pela polícia, entrevistas com cientistas de dados que alertam sobre o poder crescente dessas tecnologias e debates com líderes comunitários que sofrem diretamente as consequências dessas injustiças automatizadas.

A narrativa mescla imagens de arquivo, gráficos animados explicativos, depoimentos pessoais e cenas da vida cotidiana para tornar acessíveis temas complexos.

O principal mérito do filme é tornar visível um problema enraizado no funcionamento da tecnologia contemporânea.

A partir de um exemplo concreto, somos conduzidos a compreender questões técnicas como conjuntos de dados enviesados, aprendizado de máquina e poder algorítmico.

Ao longo de Coded Bias, percebe-se a clareza na exposição do problema: empresas gigantes tendem a treinar seus algoritmos com bancos de dados pouco diversos, muitas vezes majoritariamente com rostos brancos ou masculinos.

Isso causa falhas sistemáticas ao aplicar esses sistemas a grupos sub-representados.

A direção de Shalini Kantayya, uma mulher de ascendência indiana, se sobressai pela capacidade de traduzir conceitos complexos em linguagem acessível, evitando jargões e incorporando exemplos práticos que conectam o espectador à importância do tema.

Outro aspecto positivo é a abordagem humana que permeia Coded Bias.

Apesar de lidar com tecnologia, o foco recai sobre pessoas reais cujas vidas podem ser impactadas negativamente.

A câmera privilegia entrevistas com mulheres negras, membros de comunidades marginalizadas e especialistas sensíveis às implicações sociais da inteligência artificial.

Ao contrastar a linguagem fria dos algoritmos (e seus fundadores quase sempre homens brancos) com testemunhos emocionais, a narrativa traz empatia e urgência. O documentário, portanto, não apenas informa, mas comove e motiva a reflexão.

As soluções propostas em Coded Bias

Coded Bias destaca-se ainda por sugerir algumas soluções ao longo de sua narrativa.

Ao final, os entrevistados deixam claro que a tecnologia não é inevitavelmente injusta, mas que seu desenvolvimento precisa de supervisão, diversidade nos times de criação, testes com bases de dados mais representativas e escrutínio público.

Defendem, por exemplo, a criação de órgãos regulatórios, com participação da sociedade civil, capazes de controlar sistemas de inteligência artificial, uma provocação relevante num cenário global em que, com rapidez, delegamos decisões a máquinas sem entender como elas operam.

Coded Bias também evidencia cenários que já acontecem em diversos países: uso de reconhecimento facial em espaços públicos, algoritmos de previsão de reincidência penal e sistemas de seleção de candidatos que eliminam perfis femininos.

Essas aplicações são mostradas para ressaltar que a ideia de que a tecnologia, por si só, pode ser imparcial carrega preconceitos estruturais.

Ao mesmo tempo, há encorajamento. Cada vez mais surgem projetos de lei, ações judiciais e proibições locais a essas tecnologias sem regulamentação adequada. Essa parte dá certa esperança ao espectador, sem o terrorismo ameaçador apresentado em outras obras da mesma época, como O Dilema das Redes.

Coded Bias cumpre também um papel educativo. Quem assiste ao filme obtem tem elementos para questionar, por exemplo, o uso de câmeras de reconhecimento facial em aeroportos, o emprego de IA em processos de concessão de crédito ou o uso desses sistemas por escolas para monitoramento de alunos.

O filme nutre o entendimento de que precisamos de mais diversidade na tecnologia, de representação nos dados e de transparência nos processos. Fica claro que bons sistemas necessitam de pessoas com diferentes perspectivas durante seu desenvolvimento, pois humanos são falíveis e carregam vieses.

Conclusão

Em sua conclusão, Coded Bias nos provoca a examinar como a tecnologia não é um cenário à parte, mas sim parte viva de nossa sociedade.

Ignorar esse fato é abrir espaço para discriminação algorítmica, reforço de desigualdades e vigilância sem controle.

O documentário, assim, encerra com um convite à responsabilização: governos, empresas, organizações e cidadãos precisam se engajar para criar regras que garantam justiça digital.

Essa mensagem se conecta diretamente com o contexto do direito digital brasileiro, especialmente no que tange à Lei Geral de Proteção de Dados (LGPD).

A LGPD estabelece diretrizes claras sobre coleta, tratamento e compartilhamento de dados, impondo limites éticos para empresas e órgãos públicos.

O que Coded Bias demonstra é, em parte, aquilo que a LGPD visa impedir. Ao exigir princípios como finalidade, adequação, necessidade e transparência, a lei obriga desenvolvedores a refletir sobre os impactos dos algoritmos.

Assim, o documentário, ao exibir a jornada de Buolamwini, as falhas das big techs e as reações da sociedade, oferece reflexão essencial para o Brasil, mostrando que a tecnologia pode reforçar preconceitos ou promover justiça. O que vai prevalecer depende da regulação, diversidade e atenção ética da sociedade.

Em última análise, Coded Bias revela que a regulação da tecnologia não é um entrave ao progresso, mas sim um meio de garantir que a inovação sirva ao bem-estar coletivo, respeite a dignidade humana e cuide das minorias.